|

|

马上注册,结交更多好友,享用更多功能^_^

您需要 登录 才可以下载或查看,没有账号?立即注册

x

本帖最后由 脑子 于 2018-5-25 21:25 编辑

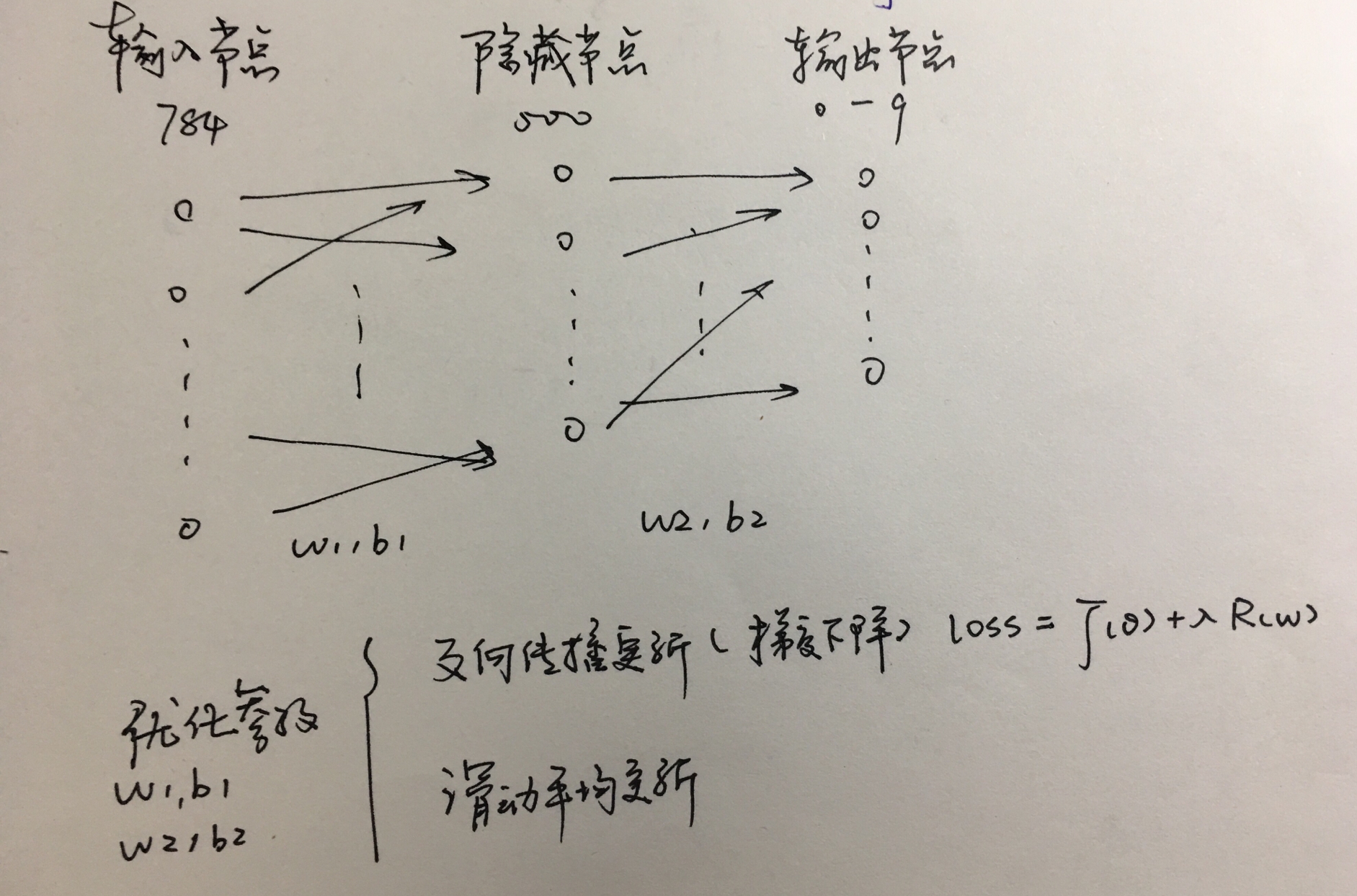

第5章:MNIST数字识别问题

======================================================

代码如下:

0.导入模块:

- import tensorflow as tf

- from tensorflow.examples.tutorials.mnist import input_data

1.配置参数

- INPUT_NODE = 784 # 输入节点

- OUTPUT_NODE = 10 # 输出节点

- LAYER1_NODE = 500 # 隐藏层节点数

- BATCH_SIZE = 100 # 每次batch打包的样本个数

- # 模型相关的参数

- LEARNING_RATE_BASE = 0.8 #基础学习率

- LEARNING_RATE_DECAY = 0.99 #学习率的衰减率

- REGULARAZTION_RATE = 0.0001 #正则化项在损失函数中的系数

- TRAINING_STEPS = 5000 #训练轮数

- MOVING_AVERAGE_DECAY = 0.99 #滑动平均衰减率

2.辅助函数:用于让我们输入神经网络中的输入和所有参数,并计算神经网络中的前向传播结果。

- def inference(input_tensor, avg_class, weights1, biases1, weights2, biases2): #input_tensor:输入;avg_class:是否使用滑动平滑;

- # 不使用滑动平均类

- if avg_class == None:

- layer1 = tf.nn.relu(tf.matmul(input_tensor, weights1) + biases1)

- return tf.matmul(layer1, weights2) + biases2

- else:

- # 使用滑动平均类

- layer1 = tf.nn.relu(tf.matmul(input_tensor, avg_class.average(weights1)) + avg_class.average(biases1))

- return tf.matmul(layer1, avg_class.average(weights2)) + avg_class.average(biases2)

计算损失函数时会一并计算softmax函数,这里只是对参数的结果输出,不需要计算softmax。

“softmax function is a generalization of the logistic function that maps a length-p vector of real values to a length-K vector of values”

意思是:softmax函数是逻辑函数的一个推广,它将一个有实值的长度为p的向量映射到一个长度为k的向量上。

softmax层是一个额外层,将结果转换为概率分布。

3.定义训练过程

- def train(mnist):

- x = tf.placeholder(tf.float32, [None, INPUT_NODE], name='x-input')

- y_ = tf.placeholder(tf.float32, [None, OUTPUT_NODE], name='y-input')

- # 生成隐藏层的参数。

- weights1 = tf.Variable(tf.truncated_normal([INPUT_NODE, LAYER1_NODE], stddev=0.1))

- biases1 = tf.Variable(tf.constant(0.1, shape=[LAYER1_NODE]))

- # 生成输出层的参数。

- weights2 = tf.Variable(tf.truncated_normal([LAYER1_NODE, OUTPUT_NODE], stddev=0.1))

- biases2 = tf.Variable(tf.constant(0.1, shape=[OUTPUT_NODE]))

- # 计算不含滑动平均类的前向传播结果

- y = inference(x, None, weights1, biases1, weights2, biases2)

-

- # 定义训练轮数及相关的滑动平均类

- global_step = tf.Variable(0, trainable=False)

- variable_averages = tf.train.ExponentialMovingAverage(MOVING_AVERAGE_DECAY, global_step) #该函数用于采用滑动平均的方法更新参数,给定衰减率和训练轮数

- variables_averages_op = variable_averages.apply(tf.trainable_variables()) #定义一个更新变量的操作;在所有除辅助变量(如trainable=false的globel_step)上使用滑动平均

- average_y = inference(x, variable_averages, weights1, biases1, weights2, biases2) #计算含滑动平均类的前向传播结果

-

- # 计算交叉熵及其平均值

- cross_entropy = tf.nn.sparse_softmax_cross_entropy_with_logits(y, tf.argmax(y_, 1) ) #计算交叉熵作为预测值与真实值之间差距的损失函数;

- #argmax(y_, 1)函数用于按行取最大值的下标

- cross_entropy_mean = tf.reduce_mean(cross_entropy) #batch中所有交叉熵平均值

-

- # 损失函数的计算(使用L2正则化损失函数->避免过拟合)

- regularizer = tf.contrib.layers.l2_regularizer(REGULARAZTION_RATE)

- regularaztion = regularizer(weights1) + regularizer(weights2) #记做:R(W);通常只正则化权重不正则化偏置项b

- loss = cross_entropy_mean + regularaztion #总损失=交叉熵损失+正则化损失

-

- # 设置指数衰减的学习率。

- learning_rate = tf.train.exponential_decay(

- LEARNING_RATE_BASE, #初始学习率

- global_step, #当前轮数

- mnist.train.num_examples / BATCH_SIZE, #batch的个数

- LEARNING_RATE_DECAY, #学习率衰减速度

- staircase=True)

-

- # 优化损失函数(梯度下降)

- train_step = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss, global_step=global_step)

-

- # 反向传播更新参数和更新每一个参数的滑动平均值

- with tf.control_dependencies([train_step, variables_averages_op]):

- train_op = tf.no_op(name='train')

- # 计算正确率

- correct_prediction = tf.equal(tf.argmax(average_y, 1), tf.argmax(y_, 1))

- accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

-

- # 初始化会话,并开始训练过程。

- with tf.Session() as sess:

- tf.global_variables_initializer().run()

- validate_feed = {x: mnist.validation.images, y_: mnist.validation.labels}

- test_feed = {x: mnist.test.images, y_: mnist.test.labels}

-

- # 循环的训练神经网络。

- for i in range(TRAINING_STEPS):

- if i % 1000 == 0:

- validate_acc = sess.run(accuracy, feed_dict=validate_feed)

- print("After %d training step(s), validation accuracy using average model is %g " % (i, validate_acc))

-

- xs,ys=mnist.train.next_batch(BATCH_SIZE)

- sess.run(train_op,feed_dict={x:xs,y_:ys})

- test_acc=sess.run(accuracy,feed_dict=test_feed)

- print(("After %d training step(s), test accuracy using average model is %g" %(TRAINING_STEPS, test_acc)))

-

ps.滑动平均模型:

在使用随机梯度下降模型时,使用滑动平均模型可以使模型在测试数据上更健壮。

ExponentialMovingAverage对每一个变量variable维护一个影子变量shadow_variable:

shadow_variable=decay*shadow_variable+(1-decay)*variable

其中:decay为衰减率。

5.主程序入口

- def main(argv=None):

- mnist = input_data.read_data_sets("../../../datasets/MNIST_data", one_hot=True)

- train(mnist)

- if __name__=='__main__':

- main()

|

|

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)