|

|

马上注册,结交更多好友,享用更多功能^_^

您需要 登录 才可以下载或查看,没有账号?立即注册

x

本帖最后由 一个账号 于 2020-2-8 21:44 编辑

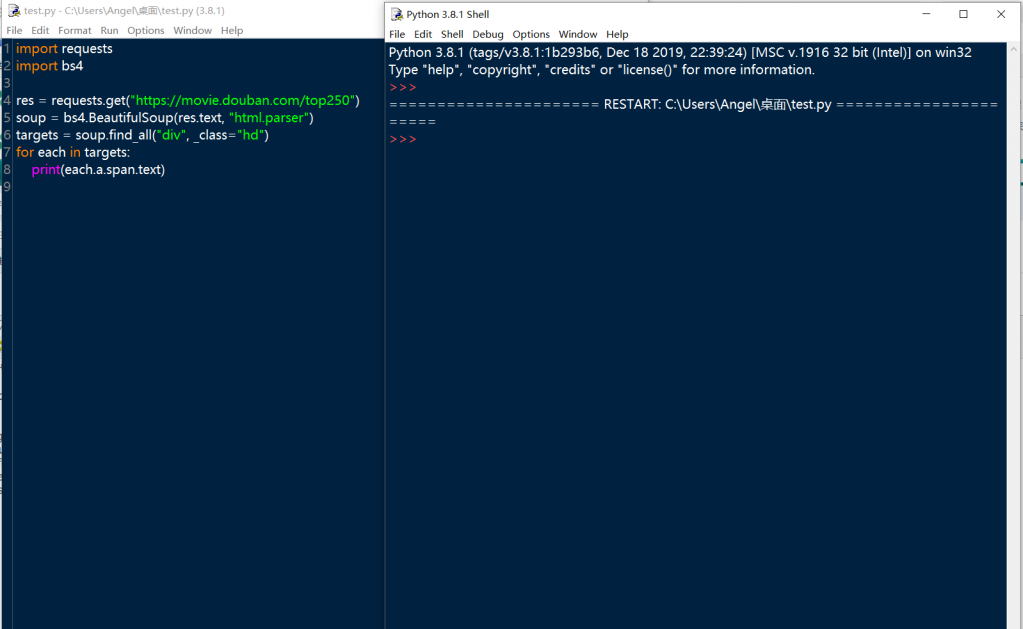

就是运行之后什么都没有,刚刚调试了一下,好像执行到第 7 行就不执行了,这是为什么?

代码如下:

- import requests

- import bs4

- res = requests.get("https://movie.douban.com/top250")

- soup = bs4.BeautifulSoup(res.text, "html.parser")

- targets = soup.find_all("div", _class="hd")

- for each in targets:

- print(each.a.span.text)

图片:

这样呢?

- import requests

- import bs4

- res = requests.get("https://movie.douban.com/top250", headers={

- "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 "

- "(KHTML, like Gecko) Chrome/76.0.3809.87 Safari/537.36"})

- soup = bs4.BeautifulSoup(res.text, "html.parser")

- targets = soup.find_all("div", class_="hd")

- for each in targets:

- print(each.a.span.text)

|

|

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)