|

|

ВнЙПЧұІбӘ¬ҢбҢ»ёь¶ағГУСӘ¬ПнУГёь¶а№¦ДЬ^_^

ДъРиТҒ µЗВә ІЕүЙТФПВФШ»тІйүөӘ¬Г»УРХЛғЕӘүБұәөЧұІб

x

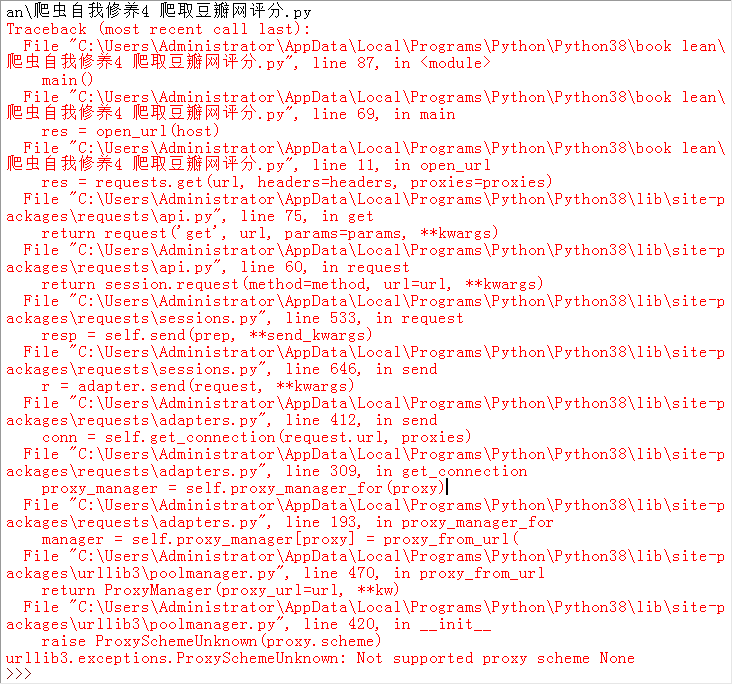

Traceback (most recent call last):

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\book lean\ЕАіжЧФОТРЮСш4 ЕАИҰ¶№°кНшЖА·Ц.py", line 87, in <module>

main()

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\book lean\ЕАіжЧФОТРЮСш4 ЕАИҰ¶№°кНшЖА·Ц.py", line 69, in main

res = open_url(host)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\book lean\ЕАіжЧФОТРЮСш4 ЕАИҰ¶№°кНшЖА·Ц.py", line 11, in open_url

res = requests.get(url, headers=headers, proxies=proxies)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\requests\api.py", line 75, in get

return request('get', url, params=params, **kwargs)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\requests\api.py", line 60, in request

return session.request(method=method, url=url, **kwargs)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\requests\sessions.py", line 533, in request

resp = self.send(prep, **send_kwargs)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\requests\sessions.py", line 646, in send

r = adapter.send(request, **kwargs)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\requests\adapters.py", line 412, in send

conn = self.get_connection(request.url, proxies)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\requests\adapters.py", line 309, in get_connection

proxy_manager = self.proxy_manager_for(proxy)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\requests\adapters.py", line 193, in proxy_manager_for

manager = self.proxy_manager[proxy] = proxy_from_url(

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\urllib3\poolmanager.py", line 470, in proxy_from_url

return ProxyManager(proxy_url=url, **kw)

File "C:\Users\Administrator\AppData\Local\Programs\Python\Python38\lib\site-packages\urllib3\poolmanager.py", line 420, in __init__

raise ProxySchemeUnknown(proxy.scheme)

urllib3.exceptions.ProxySchemeUnknown: Not supported proxy scheme None

ФЛРР№эіМЦРіцПЦХвР©ОКМв ЗлРҰәЧУг°пЦъТ»ПВ |

-

ОКМвГиКц

|

( ФБICP±ё18085999ғЕ-1 | ФБ№«Нш°І±ё 44051102000585ғЕ)

( ФБICP±ё18085999ғЕ-1 | ФБ№«Нш°І±ё 44051102000585ғЕ)