|

|

10гуБв

- import requests

- import bs4

- import re

- def open_url(url):

- #ЪЙгУДњРэ

- # proxies = {'https':'223.243.174.152:9999','https':'223.214.205.179:9999'}

- headers = {'user-agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/99.0.4844.74 Safari/537.36 Edg/99.0.1150.46'}

- res = requests.get(url,headers=headers)

- return res

- def find_movies(res):

- #ьРЬР

- soup = bs4.BeautifulSoup(res.text,'html.parser')

- #ЕчгАУћ

- movies = []

- targets = soup.find_all('div',class_ = 'hd')

- for each in targets:

- movies.append(each.a.span.text)

- #ЦРЗж

- ranks = []

- targets = soup.find_all('span',class_='rating_num')

- for each in targets:

- ranks.append('ЦРЗж%s'%each.text)

- #зЪСЯ

- messages = []

- targets = soup.find_all('div',class_='bd')

- for each in targets:

- try:

- messages.append(each.p.text.split('\n')[0].strip() + each.p.text.split('\n')[1].strip())

- except:

- continue

- result = []

- length = len(movies)

- for i in range(length):

- result.append(movies[i] + ranks[i] + messages[i] +'\n')

- return result

- #евГівЛЙВгаЖрЩйИівГУц

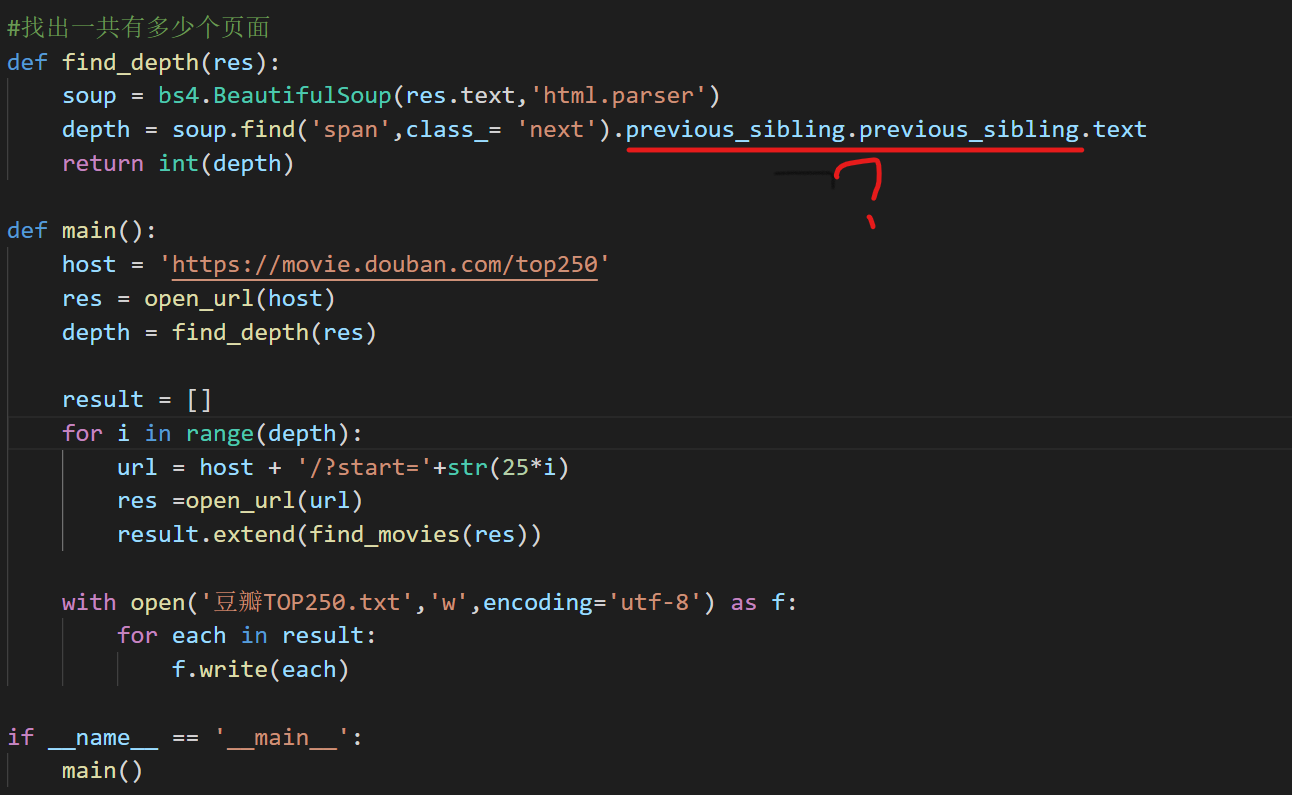

- def find_depth(res):

- soup = bs4.BeautifulSoup(res.text,'html.parser')

- depth = soup.find('span',class_= 'next').previous_sibling.previous_sibling.text #етвЛааЪВУДвтЫМбН?

- return int(depth)

- def main():

- host = 'https://movie.douban.com/top250'

- res = open_url(host)

- depth = find_depth(res)

- result = []

- for i in range(depth):

- url = host + '/?start='+str(25*i)

- res =open_url(url)

- result.extend(find_movies(res))

- with open('ЖЙАъTOP250.txt','w',encoding='utf-8') as f:

- for each in result:

- f.write(each)

- if __name__ == '__main__':

- main()

|

|

( дСICPБИ18085999КХ-1 | дСЙЋЭјАВБИ 44051102000585КХ)

( дСICPБИ18085999КХ-1 | дСЙЋЭјАВБИ 44051102000585КХ)