|

|

马上注册,结交更多好友,享用更多功能^_^

您需要 登录 才可以下载或查看,没有账号?立即注册

x

win 10

python 3.6.2

程序代码如下:

import urllib.request

import os

def url_open(url):

req=urllib.request.Request(url)

req.add_header('User-Agent','Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/60.0.3112.113 Safari/537.36')

response=urllib.request.urlopen(url)

html=response.read()

return html

def get_page(url):

html=url_open(url).decode('utf-8')

a=html.find('current-comment-page')+23

b=html.find(']',a)

return html[a:b]

def find_imgs(url):

html=url_open(url).decode('utf-8')

img_addrs=[]

a=html.find('img src=')

while a!=-1:

b=html.find('.jpg',a,a+255)

c=html.find('.gif',a,a+255)

if b!=-1:

img_addrs.append(html[a+9:b+4])

else:

b=a+9

a=html.find('img src=',b)

return img_addrs

def save_imgs(folder,img_addrs):

for each in img_addrs:

filename=each.split('/')[-1]

with open(filename,'wb') as f:

img=url_open(each)

f.write(img)

def download_mm(folder='C:\\Users\\Administrator\\Desktop\\ooxx',pages=10):

os.mkdir(folder)

os.chdir(folder)

url='http://jandan.net/ooxx/'

page_num=int(get_page(url))

for i in range(pages):

page_num=page_num-i

page_url=url+'page-'+str(page_num)+'#comments'

img_addrs=find_imgs(page_url)

save_imgs(folder,img_addrs)

if __name__=='__main__':

download_mm()

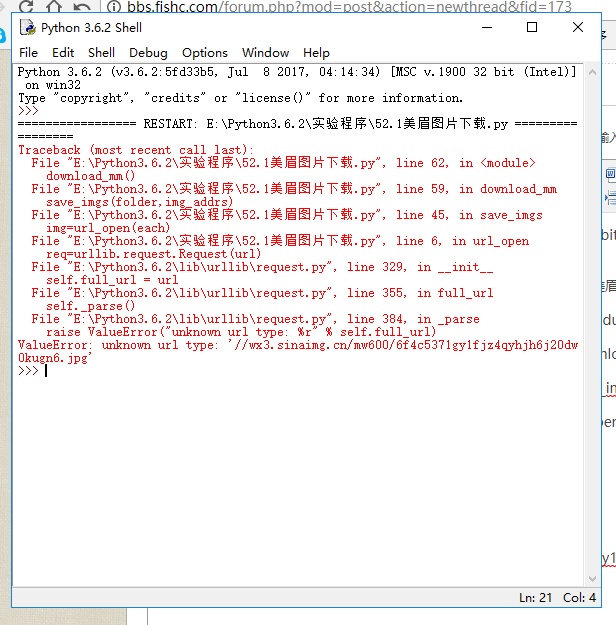

执行后,错误提示如下:

Python 3.6.2 (v3.6.2:5fd33b5, Jul 8 2017, 04:14:34) [MSC v.1900 32 bit (Intel)] on win32

Type "copyright", "credits" or "license()" for more information.

>>>

================= RESTART: E:\Python3.6.2\实验程序\52.1美眉图片下载.py =================

Traceback (most recent call last):

File "E:\Python3.6.2\实验程序\52.1美眉图片下载.py", line 62, in <module>

download_mm()

File "E:\Python3.6.2\实验程序\52.1美眉图片下载.py", line 59, in download_mm

save_imgs(folder,img_addrs)

File "E:\Python3.6.2\实验程序\52.1美眉图片下载.py", line 45, in save_imgs

img=url_open(each)

File "E:\Python3.6.2\实验程序\52.1美眉图片下载.py", line 6, in url_open

req=urllib.request.Request(url)

File "E:\Python3.6.2\lib\urllib\request.py", line 329, in __init__

self.full_url = url

File "E:\Python3.6.2\lib\urllib\request.py", line 355, in full_url

self._parse()

File "E:\Python3.6.2\lib\urllib\request.py", line 384, in _parse

raise ValueError("unknown url type: %r" % self.full_url)

ValueError: unknown url type: '//wx3.sinaimg.cn/mw600/6f4c5371gy1fjz4qyhjh6j20dw0kugn6.jpg'

请问错在哪里了呢,该如何修改呢?

仔细对比下:

- import urllib.request

- import sys

- import os

- def url_open(url):

- req = urllib.request.Request(url)

- req.add_header('User-Agent',

- 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.87 Safari/537.36')

- resp = urllib.request.urlopen(url)

- html = resp.read()

- # print(html)

- return html

- def get_page(url): # 获取图片页码

- html = url_open(url).decode('utf-8') # 解码,之后查找图片页码做准备

- a = html.find('current-comment-page') + 23 # 返回页码数的首位置

- b = html.find(']', a) # 返回页码数的末位置

- # print(html[a:b])

- return html[a:b] # 拼接返回页码

- def find_imgs(url): # 在当前URL查找图片

- html = url_open(url).decode('utf-8')

- img_addrs = []

- a = html.find('img src=') # 图片真实地址

- while a != -1:

- b = html.find('.jpg', a, a + 200)

- if b != -1:

- img_addrs.append(html[a + 9:b + 4])

- else:

- b = a + 9

- a = html.find('img src=', b)

- return img_addrs

- def save_imgs(img_addrs):

- for each in img_addrs:

- filename = each.split('/')[-1]

- with open(filename, 'wb') as f:

- img = url_open("http:"+each)

- f.write(img)

- def download(folder='Girls', pages=20):

- os.mkdir(folder) # 创建文件夹

- os.chdir(folder) # 切换到文件夹目录

- url = 'http://jandan.net/ooxx'

- page_num = int(get_page(url)) # 获取当前该图片页码

- for i in range(pages): # 依次下载指定页数的图片

- page_num -= 1

- page_url = url + '/page-' + str(page_num) + '#comments' # 图片的URL

- # print(page_url)

- img_addrs = find_imgs(page_url)

- save_imgs(img_addrs)

- if __name__ == '__main__':

- download()

|

-

|

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)